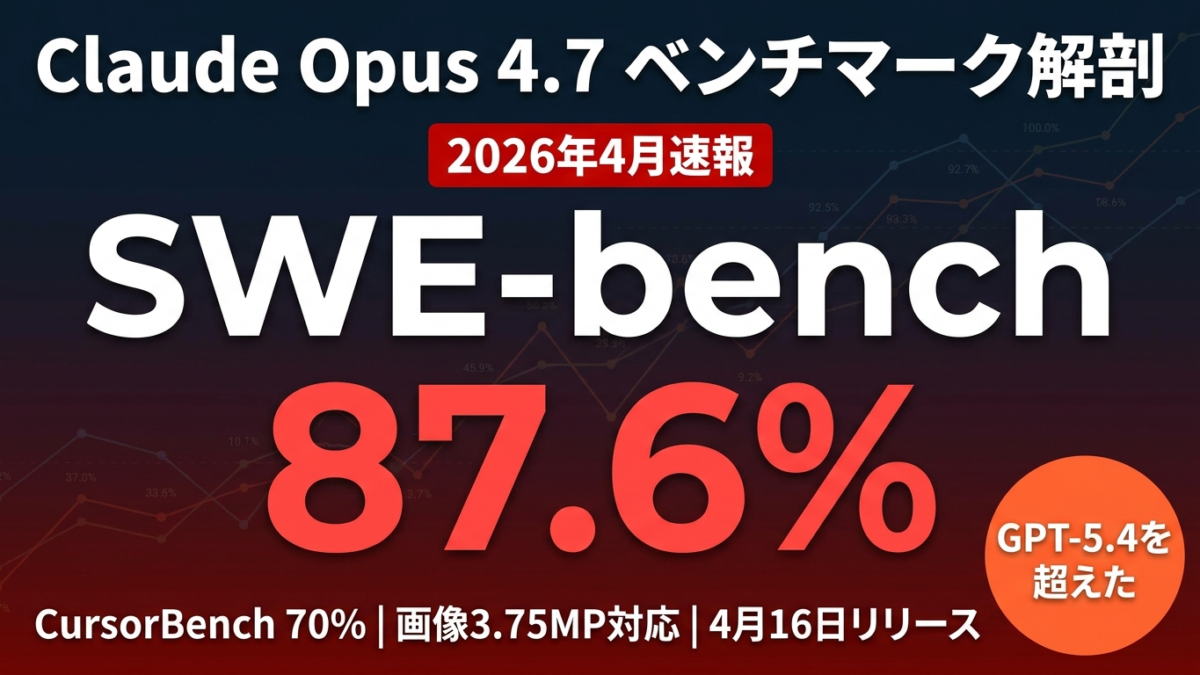

2026年4月16日、AnthropicがClaude Opus 4.7をリリースした。発表と同時に公開されたベンチマーク数値を見て、正直驚いた。SWE-bench Verified 87.6%、CursorBench 70%——これは単なる数字の更新ではなく、コーディングエージェントの実用性が一段階上がったことを示している。

ただ、数字だけを見ていても何も分からない。SWE-benchの「Verified」と「Pro」の違いは何か。CursorBenchのスコアがなぜ実務に直結するのか。新しいトークナイザーは料金にどう影響するのか。この記事では、各ベンチマークの技術的な意味を分解して整理する。

ベンチマーク結果サマリー

まず全体像を把握しておこう。

| ベンチマーク | Opus 4.7 | Opus 4.6 | GPT-5.4 | Gemini 3.1 Pro |

|---|---|---|---|---|

| SWE-bench Verified | 87.6% | 80.8% | — | 80.6% |

| SWE-bench Pro | 64.3% | 53.4% | 57.7% | 54.2% |

| CursorBench | 70% | 58% | — | — |

| コンテキストウィンドウ | 1M tokens | 1M tokens | — | 2M tokens |

| 画像入力 | 3.75MP | 〜1MP | — | — |

SWE-bench Pro: 公式発表値(参照日: 2026-04-16)。GPT-5.4のCursorBench/SWE-bench Verified非公開。

SWE-bench VerifiedとProの違い

「SWE-bench 87.6%」という数字をそのまま受け取ると、誤解が生じる。この数値が指すのはSWE-bench Verified——つまり、OpenAIが人手でフィルタリングした約2,294件のサブセットのスコアだ。

一方、SWE-bench Proは本番コードベースの実際のIssueを解決する能力を測定する。より難しく、より実務に近い。Opus 4.7はこちらで64.3%を達成しており、Opus 4.6(53.4%)から約11ポイント向上している。

GPT-5.4がSWE-bench Proで57.7%なのに対して、Opus 4.7は64.3%——この差はエージェント的なコーディングタスクで特に顕著に出てくる。

スコアの技術的意味

SWE-benchのタスクは単純なコード補完ではない。GitHubのIssueを読んで、リポジトリ全体を理解して、適切なファイルを特定して、パスするテストを書きながら修正を加える——この一連の作業を自律的にこなせるかを問う。64.3%は「3件に2件は独力で解決できる」ことを意味する。

CursorBench 70%が実務開発者に意味すること

CursorBenchはCursorのチームが設計したベンチマークで、実際のIDE環境での自律的なコーディング性能を測定する。Cursor内でAIエージェントとして動く際の実力指標といえる。

Opus 4.6が58%、Opus 4.7が70%——12ポイントの差は、「実際のプロジェクトで詰まる頻度」の差として体感できるレベルだ。Agent Modeで複数ファイルにまたがるリファクタリングを指示したとき、途中でコンテキストが破綻しない確率が上がっている。

Cursorは現在Anthropicモデルを優先的にサポートしており、Opus 4.7はリリース当日からAPI経由で使用可能になっている。

新機能1:xhigh推論レベルとTask Budget

Opus 4.7の技術的な新要素のひとつが、推論努力レベルに追加された「xhigh」だ。

従来のextended thinking budgetに代わり、Opus 4.7ではlow / medium / high / xhigh という4段階のシンプルな設定になった。xhighは複雑なコーディングタスクや長いエージェントループ向けで、内部推論により多くのトークンを割り当てることで出力品質を上げる。レイテンシは増えるが、難易度の高いタスクほど効果が大きい。

もうひとつの新機能がTask Budget。エージェントループ全体のトークン使用量目標を指定すると、モデルがそれを参照しながら作業を優先度付けし、予算内で完了させようとする。コスト管理とエージェントの完走率を両立させるための仕組みだ。

# Opus 4.7 xhigh推論レベルの設定例

# 動作環境: Python 3.11+, anthropic>=0.30.0

# pip install anthropic

import anthropic

client = anthropic.Anthropic()

# xhigh推論レベルでコーディングタスク

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=16000,

thinking={

"type": "enabled",

"effort": "xhigh" # low / medium / high / xhigh

},

messages=[{

"role": "user",

"content": """

以下のPythonコードのパフォーマンスボトルネックを特定し、

最適化案をコードで提示してください:

def process_large_dataset(data):

result = []

for item in data:

if item['value'] > 100:

result.append({

'id': item['id'],

'processed': item['value'] * 2

})

return result

"""

}]

)

# 注意: 本番環境で使用する前に、必ずテスト環境で動作確認してください。

print(response.content)新機能2:画像入力3.75MP対応

Opus 4.7は画像の長辺最大2,576ピクセル(約3.75メガピクセル)まで受け付けるようになった。従来のClaude Opus系は最大約1MPだったため、3倍以上の拡張だ。

これがエージェント開発に影響するのは、スクリーンショット経由のUI操作やドキュメント解析ワークフローだ。高解像度のUIを渡してもピクセルが潰れず、コンポーネントの認識精度が上がる。PDFの図表や設計書の細かい文字も読めるようになる。

# 画像入力でUI解析エージェント(3.75MP対応例)

# 動作環境: Python 3.11+, anthropic>=0.30.0

import anthropic

import base64

client = anthropic.Anthropic()

# スクリーンショットをbase64でエンコード

def encode_image(image_path: str) -> str:

with open(image_path, "rb") as f:

return base64.standard_b64encode(f.read()).decode("utf-8")

# 高解像度UI画像を渡してエラー分析

image_data = encode_image("screenshot_1920x1080.png") # ~2MPのスクリーンショット

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=2000,

messages=[{

"role": "user",

"content": [

{

"type": "image",

"source": {

"type": "base64",

"media_type": "image/png",

"data": image_data

}

},

{

"type": "text",

"text": "このUIスクリーンショットのエラー表示を特定し、原因と修正方針を教えてください。"

}

]

}]

)

# 注意: 本番環境で使用する前に、必ずテスト環境で動作確認してください。

print(response.content[0].text)新トークナイザーとコストの実態

価格は$5/1M input、$25/1M outputでOpus 4.6と同じ。しかし新しいトークナイザーにより、同じテキストを渡すと最大35%多くのトークンに変換される場合がある。

実質的なコストへの影響:

| コンテンツタイプ | トークン増加率(目安) | 実質コスト変化 |

|---|---|---|

| 英語テキスト(コード含む) | 〜10-20% | +10〜20% |

| 日本語テキスト | 〜5-15% | +5〜15% |

| 画像(JPG/PNG) | 変化なし(ピクセル単位) | 変化なし〜増加 |

| 長文コードファイル | 〜25-35% | +25〜35% |

増加率はコンテンツ内容により異なる。公式はmax 35%増と案内。参照日: 2026-04-16

大量APIコールを行うエージェントシステムでは、本番切り替え前に既存プロンプトでのトークン消費量をテストしておくことを強く推奨する。

# トークン消費量を事前確認するコード

# 動作環境: Python 3.11+, anthropic>=0.30.0

import anthropic

client = anthropic.Anthropic()

def estimate_token_usage(prompt: str, model: str = "claude-opus-4-7") -> dict:

"""同一プロンプトでOpus 4.6と4.7のトークン消費量を比較"""

response = client.messages.count_tokens(

model=model,

messages=[{"role": "user", "content": prompt}]

)

return {"model": model, "input_tokens": response.input_tokens}

# 既存プロンプトでの比較

test_prompt = "あなたのシステムプロンプトや実際に使っているプロンプトをここに貼る"

opus_46_count = estimate_token_usage(test_prompt, "claude-opus-4-6")

opus_47_count = estimate_token_usage(test_prompt, "claude-opus-4-7")

increase_pct = (opus_47_count["input_tokens"] / opus_46_count["input_tokens"] - 1) * 100

print(f"Opus 4.6: {opus_46_count['input_tokens']} tokens")

print(f"Opus 4.7: {opus_47_count['input_tokens']} tokens")

print(f"増加率: {increase_pct:.1f}%")

# 注意: 本番環境で使用する前に、必ずテスト環境で動作確認してください。GPT-5.4・Gemini 3.1 Proとの使い分け

3モデルの特性を整理しておく。

| 観点 | Claude Opus 4.7 | GPT-5.4 | Gemini 3.1 Pro |

|---|---|---|---|

| コーディングエージェント | ◎(SWE Pro 64.3%) | 〇(SWE Pro 57.7%) | 〇(SWE Pro 54.2%) |

| コンテキストウィンドウ | 1M tokens | — | 2M tokens |

| マルチモーダル | 3.75MP画像対応 | — | — |

| 日本語精度 | 高 | 高 | 高 |

| 価格(input) | $5/1M | — | — |

GPT-5.4・Gemini 3.1 Proの詳細スペックは各社公式サイトで確認のこと。参照日: 2026-04-16

大規模コードベースのエージェントはGemini 3.1 Proの2Mトークン文脈が有利な場面もある。しかし自律タスク完了率という意味では、現時点でOpus 4.7がリードしている。

【要注意】Opus 4.7移行で注意すべき3点

注意点1:新トークナイザーによるコスト増

前述の通り、同一プロンプトで最大35%のトークン増が起きる。大量バッチ処理を行っているシステムは事前に検証すること。

注意点2:xhigh推論レベルはレイテンシが高い

xhighはリアルタイムチャットには不向きだ。非同期で時間をかけていいバッチタスクやCI/CDパイプラインで使うのが適切。ユーザー向け対話インターフェースにxhighを使うと、応答速度への不満が出る可能性がある。

注意点3:モデルIDの確認

APIのモデルIDは claude-opus-4-7(ハイフン区切り)。Amazon Bedrock経由の場合は anthropic.claude-opus-4-7-20260416-v1:0 形式になる。Vertex AI等でも同日提供開始されているが、リージョン可用性はプラットフォームごとに異なる。

用途別おすすめ

- コーディングエージェント・CI/CD自動化 → Opus 4.7(SWE-benchリード)

- 文書解析・高解像度画像理解 → Opus 4.7(3.75MP対応)

- 超長文コードベース全体の把握 → Gemini 3.1 Pro(2Mトークン)を検討

- コスト最優先のルーティング先 → Claude Sonnet 4.6 / Haiku 4.5を維持

参考・出典

- Introducing Claude Opus 4.7 — Anthropic(参照日: 2026-04-16)

- Anthropic releases Claude Opus 4.7, narrowly retaking lead for most powerful generally available LLM — VentureBeat(参照日: 2026-04-16)

- Claude Opus 4.7 leads on SWE-bench and agentic reasoning — The Next Web(参照日: 2026-04-16)

- Decoding the Official Release of Claude Opus 4.7 — Apiyi.com(参照日: 2026-04-16)

- Claude Opus 4.7 pricing: $5/1M, new tokenizer explained — TokenCost(参照日: 2026-04-16)

まとめ:Opus 4.7で変わること

- 今日確認: コーディングエージェントを使っているなら、既存プロンプトのトークン消費量を

count_tokensAPIで測定してコスト影響を把握する - 今週中: SWE-bench Proでスコアが上がった自律コーディング能力をCI/CDや自動レビューパイプラインで試してみる

- 今月中: xhigh推論とTask Budgetを組み合わせた長時間エージェントループの精度改善を検証する

あわせて読みたい:

- Claude Computer Useでデスクトップ操作エージェントを実装する完全ガイド — コーディング以外の自律実行に

- LLMルーティング×プロンプトキャッシングでAPIコストを削減する — 新モデルへの移行コスト管理に

この記事を読んでOpus 4.7の導入イメージが固まってきた方へ

UravationではAIエージェント導入の研修・コンサルを行っています。ベンチマーク数値を実務に落とし込む支援もお気軽にご相談ください。

著者: 佐藤傑(さとう・すぐる)

株式会社Uravation代表取締役。X(@SuguruKun_ai)フォロワー10万人超。

100社以上の企業向けAI研修・導入支援。著書累計3万部突破。